VRAM(Video Random Access Memory)은 그래픽 카드(GPU)에 탑재된 메모리로, 영상 처리 및 그래픽 연산을 담당하는 고속 메모리입니다. 일반적으로 게임, 영상 편집, 3D 모델링 등에 사용되지만, 최근에는 인공지능(AI)과 딥러닝(deep learning) 학습에서도 핵심적인 역할을 합니다.

1. VRAM이란 무엇인가?

VRAM(Video Random Access Memory)은 **GPU(Graphics Processing Unit)**가 데이터를 빠르게 처리할 수 있도록 설계된 고속 메모리입니다. 그래픽 렌더링뿐만 아니라 딥러닝, AI 모델 학습, 데이터 분석 등 고성능 컴퓨팅 작업에서도 필수적인 역할을 합니다.

딥러닝에서는 GPU가 수천 개의 코어를 활용하여 병렬 연산을 수행하는데, 이때 데이터(이미지, 텐서 등)를 저장하고 빠르게 처리하기 위해 VRAM이 필요합니다. VRAM이 부족하면 학습 속도가 느려지고, 심한 경우 학습 자체가 불가능할 수도 있습니다.

import torch

print(f"사용 가능한 VRAM: {torch.cuda.memory_allocated(0)/1024**3:.2f}GB")* PyTorch로 VRAM 사용량 확인이 가능합니다.(PyTorch 라이브러리 설치 필수)

2. VRAM의 역할: AI 학습에서 중요한 이유

2.1 데이터 로드 및 저장

딥러닝 모델을 학습하려면 대량의 데이터(이미지, 텍스트, 오디오, 비디오 등)를 빠르게 로드해야 합니다. VRAM이 크면 더 많은 데이터를 한 번에 GPU로 로드할 수 있어 학습 속도가 빨라집니다. 반면 VRAM이 부족하면 데이터를 CPU RAM에서 불러와야 하는데, 이 과정은 속도를 크게 저하시킵니다.

2.2 모델 크기와 VRAM의 관계

딥러닝 모델은 대량의 데이터를 빠르게 로드해야 합니다. VRAM이 크면 더 많은 데이터를 한 번에 GPU로 로드할 수 있어 학습 속도가 빨라지며, 부족하면 CPU RAM을 사용하게 되어 속도가 크게 저하됩니다. 딥러닝 모델이 크면 더 많은 가중치(Weights)와 활성화 값(Activations) 을 저장해야 하므로 VRAM 사용량이 증가합니다.

| 용도 | 필요 VRAM |

|---|---|

| 간단한 모델 학습 (MNIST, CIFAR-10) | 4~8GB |

| 중급 모델 (ResNet, U-Net, Transformer) | 12~16GB |

| 대형 모델 (GPT-3, Stable Diffusion) | 24~48GB |

| 초대형 모델 (LLaMA, GPT-4) | 48GB 이상 또는 멀티 GPU |

예를 들어, Stable Diffusion을 사용해 512×512 크기의 이미지를 생성하려면 최소 4GB VRAM이 필요하며, 1024×1024 해상도에서는 12GB 이상이 필요합니다.

2.3 배치 크기(Batch Size)와 VRAM

배치 크기(Batch Size)는 한 번에 학습하는 데이터 개수를 의미합니다. 배치 크기가 크면 학습 속도가 빨라지지만, 더 많은 VRAM이 필요합니다.

| 배치 크기 | 필요 VRAM 용량 |

|---|---|

| 32 | 8GB |

| 128 | 16GB |

| 512 | 48GB 이상 |

즉, VRAM이 클수록 더 큰 배치 크기로 빠르게 학습할 수 있으며, 학습 속도 향상에 기여합니다.

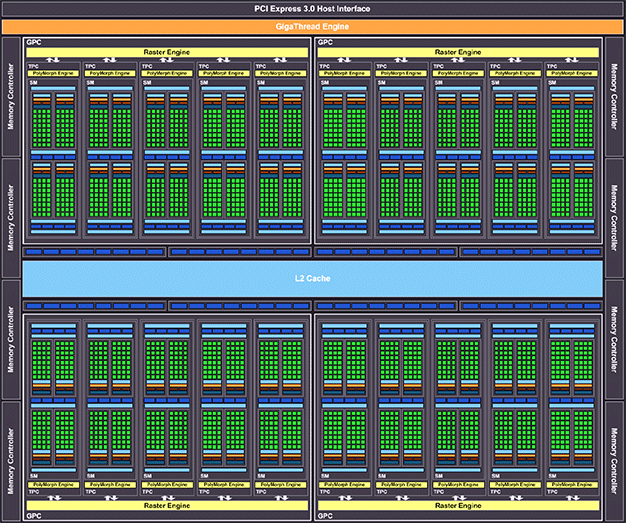

3. VRAM의 양과 GPU 아키텍처

VRAM 용량은 GPU 아키텍처에 따라 결정됩니다. 현대적인 GDDR6X 및 GDDR6 메모리는 8Gb(1GB) 또는 16Gb(2GB) 밀도로 제공되며, 각 메모리 칩이 GPU의 메모리 컨트롤러와 연결됩니다.

- RTX 4060 Ti (8GB) → 4개의 16Gb GDDR6 메모리 칩 사용

- RTX 4060 Ti (16GB) → 8개의 16Gb GDDR6 메모리 칩 사용

- RTX 4070 Ti (12GB) → 192비트 메모리 인터페이스 사용

즉, GPU 설계에 따라 VRAM 용량이 결정되며, 동일한 버스 폭을 가진 경우 VRAM 용량이 항상 2배로 증가하는 구조를 보입니다.

4. VRAM과 실제 AI 학습 성능

딥러닝 모델은 수많은 행렬 연산과 가중치(weight) 업데이트를 수행하며, 이를 빠르게 처리하기 위해 GPU가 활용됩니다. 하지만 VRAM이 부족하면 학습 속도가 느려지거나 학습 자체가 불가능해질 수도 있습니다.

4.1. 딥러닝 모델별 VRAM 사용량 예시

- 작은 모델 (ResNet-18) → VRAM 사용량이 적음

- 대형 모델 (GPT-4, LLaMA) → 수십 GB 이상의 VRAM 필요

4.2. 고해상도 이미지 및 자연어 처리(NLP)에서 VRAM 필요량

- 컴퓨터 비전: 고해상도(1024×1024) 이미지를 입력으로 사용할 경우 VRAM 요구량 증가

- 자연어 처리(NLP): 긴 문장을 학습할수록 더 많은 VRAM 필요

4.4 VRAM 용량이 AI 학습에 미치는 영향

충분한 VRAM이 있으면 GPU의 연산 능력을 최대한 활용할 수 있어 학습 속도가 빨라집니다. 반면 VRAM이 부족하면 일부 데이터가 시스템 RAM(DDR 메모리)으로 이동하면서 속도가 크게 저하됩니다.

컴퓨터 비전 분야에서는 고해상도 이미지를 사용해야 하는 경우가 많습니다. 예를 들어, 1024×1024 해상도의 이미지를 입력으로 사용하면 낮은 해상도의 데이터보다 훨씬 많은 VRAM이 필요합니다. 또한 자연어 처리(NLP) 모델에서도 긴 시퀀스를 학습하려면 더 많은 VRAM이 요구됩니다.

VRAM이 부족한 경우 여러 개의 GPU를 연결하여 학습하는 “멀티-GPU 학습”을 활용할 수 있습니다. 그러나 VRAM이 많으면 단일 GPU에서도 효과적인 학습이 가능하여 복잡한 분산 학습 설정 없이 연구 개발이 용이해집니다.

5. AI 모델 학습을 위한 VRAM 추천 용량

VRAM은 AI 모델 학습에서 필수적인 요소로, 용량이 충분해야 대량 데이터를 빠르게 처리하고 학습 속도를 높일 수 있습니다.

최적의 VRAM 선택 가이드

| 작업 유형 | 최소 VRAM | 권장 VRAM |

|---|---|---|

| 기본적인 CNN 학습 | 4GB | 6GB 이상 |

| NLP 모델 (BERT, GPT 등) | 8GB | 12GB 이상 |

| Stable Diffusion (이미지 생성) | 8GB | 16GB 이상 |

| 대형 Transformer 학습 (GPT-4 등) | 16GB | 24GB 이상 |

| 초대형 AI 모델 및 연구 | 24GB | 48GB 이상 |

단순한 이미지 분류 모델은 적은 VRAM으로도 학습이 가능하지만, Stable Diffusion이나 GPT-4 같은 대형 모델을 학습하려면 훨씬 더 많은 VRAM이 필요합니다. 특히, 배치 크기(batch size)가 크면 한 번에 더 많은 데이터를 처리할 수 있어 더 빠른 이미지 생성이 가능합니다. 특히, LoRA 모델을 사용한다면 24GB~48GB 이상의 VRAM을 갖춘 GPU가 필요합니다.

AI 모델을 학습할 때 VRAM(비디오 메모리)은 필수적인 요소입니다. VRAM이 충분해야 대량의 데이터를 빠르게 처리하고 학습 속도를 높일 수 있습니다 어떤 AI 모델을 학습할지에 따라 적절한 VRAM을 선택하는 것이 매우 중요합니다.

단순한 AI 작업이라면 8GB~12GB VRAM으로도 충분하지만, 대형 모델을 다룬다면 24GB 이상의 고사양 GPU를 고려하는 것이 좋습니다.

본 블로그 글을 통하여 적절한 GPU 를 선택하는데 도움이 되시길 바랍니다.