인공지능(AI)과 고사양 게임을 가능하게 하는 핵심 장치 중 하나가 바로 **그래픽 카드(GPU, Graphics Processing Unit)**입니다. GPU는 단순한 이미지 처리 장치를 넘어 초당 수십조 개의 연산을 수행하는 병렬 연산의 강력한 엔진으로 발전해 왔습니다. 특히 AI 모델을 학습하고 실행할 때 **VRAM(비디오 메모리)**의 크기가 중요한 역할을 합니다. 그렇다면 왜 VRAM이 AI 학습에 필수적일까요?

1. VRAM이 필요한 이유

1) 데이터와 모델의 크기

딥러닝 모델은 이미지, 텍스트 등의 대량 데이터를 처리하며, 이 데이터를 GPU에서 빠르게 연산하기 위해 VRAM에 로드합니다. 모델의 크기도 VRAM을 차지하는데, 특히 파라미터 수가 많고 층이 깊은 대형 모델일수록 더 많은 VRAM이 필요합니다. 만약 VRAM이 부족하면 학습이나 추론이 원활히 이루어지지 않습니다.

2) 배치 크기(batch size) 설정

AI 모델을 훈련할 때 한 번에 처리하는 데이터 묶음을 배치(batch)라고 합니다. 배치 크기가 클수록 학습 속도가 빨라지고 모델 성능도 향상될 가능성이 높지만, 그만큼 더 많은 VRAM이 필요합니다. VRAM 용량이 부족하면 배치 크기를 줄여야 하고, 이는 학습 속도와 성능 저하로 이어질 수 있습니다.

3) 계산 효율성

딥러닝에서는 중간 계산 결과를 저장하기 위해 VRAM이 사용됩니다. 특히 훈련 중에는 역전파(backpropagation) 계산을 위해 중간 결과값이 VRAM에 저장됩니다. VRAM이 충분해야 중간 계산 결과를 모두 저장하고 빠르게 계산을 수행할 수 있어 학습 성능이 향상됩니다.

4) 최신 AI 모델의 실행 필수 조건

최근의 AI 모델은 이미지 생성, 자연어 처리와 같은 복잡한 연산을 수행하며, 대량의 VRAM을 필요로 합니다. 예를 들어, Stable Diffusion과 같은 텍스트-이미지 변환 모델, GPT-4와 같은 자연어 처리 모델은 수많은 데이터와 모델 파라미터를 GPU에 올려야 원활하게 실행됩니다.

2. GPU의 연산 성능과 VRAM의 관계

1) GPU 연산 성능 비교

최신 GPU는 엄청난 연산 성능을 자랑합니다. 이를 게임 연산과 비교하면 GPU의 중요성을 쉽게 이해할 수 있습니다.

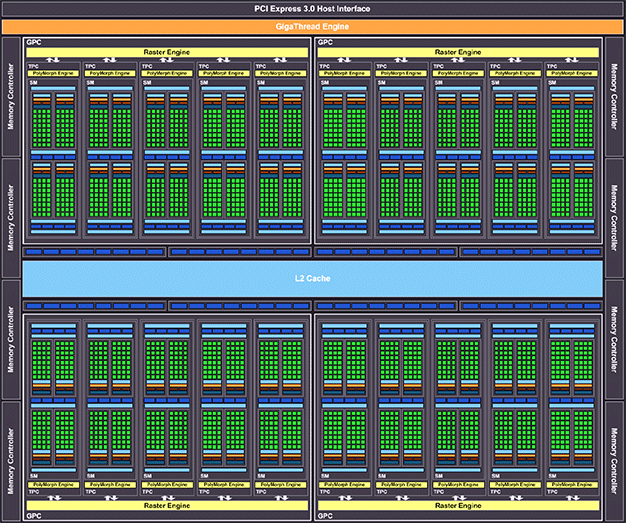

GPU는 SIMD(Single Instruction Multiple Data) 아키텍처를 활용하여 다량의 3D 데이터를 병렬 연산합니다. 예를 들어, 게임 내 3D 모델의 좌표 변환에서 하나의 연산 명령을 수천 개의 좌표에 적용하여 효율적으로 연산합니다.

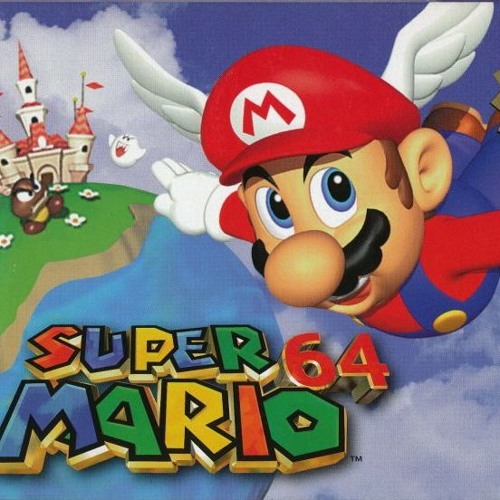

1996년: 마리오 64와 1억 번의 연산

1996년, 세상은 닌텐도 64의 슈퍼 마리오 64를 처음 만났습니다. 입체적인 3D 공간에서 마리오가 뛰고, 구르고, 점프하며 코인을 모으던 그때, 여러분이 마리오를 조작할 때마다 초당 1억 번의 연산이 이루어지고 있었습니다.

그런데 이 수치가 감이 잘 안 오신다고요? 그럼 이렇게 생각해 보세요. 만약 사람이 초당 한 번씩 수학 문제를 푼다고 하면, 마리오 64를 부드럽게 돌리려면 1억 명의 사람이 동시에 계산을 해야 한다는 뜻입니다. 네, 그 당시엔 정말 엄청난 기술이었죠!

2011년: 마인크래프트와 1천억 번의 연산

시간이 흘러 2011년, 픽셀 블록으로 이루어진 마인크래프트가 등장했습니다. 그래픽이 단순해 보여도, 사실 이 게임은 어마어마한 연산을 필요로 합니다.

플레이어가 한 블록을 부수면, 주변 블록이 영향을 받고 물리 연산이 적용되며, 그림자와 빛의 반사도 계산됩니다. 한 번의 블록 제거가 연쇄적인 계산을 일으키며, 초당 1천억 번의 연산이 필요했죠.

마리오 64와 비교하면 무려 1,000배 더 많은 연산을 필요로 합니다. 이제는 1억 명이 아니라 10억 명의 사람이 동시에 계산해야 하는 수준이 된 거죠.

2020년: 사이버펑크 2077과 36조 번의 연산

그리고 2020년, 가장 화려한 비주얼을 자랑하는 사이버펑크 2077이 출시됩니다. 초기 버그와 최적화 문제로 논란이 컸으나, 지속적 패치와 확장팩으로 완성도를 높여 현재는 호평받고 있습니다. 반짝이는 네온사인, 거리를 가득 채운 NPC, 차량의 광택, 빛의 반사와 그림자까지… 모든 요소가 초당 36조 번의 연산을 수행해야 비로소 완벽한 몰입감을 제공합니다.

이 숫자가 얼마나 클까요?

- 마리오 64 대비 36만 배

- 마인크래프트 대비 360배

지구상의 모든 사람이 1초에 한 번씩 계산을 해도 4,400개의 지구가 필요할 만큼 어마어마한 수치입니다. 이 정도면 거의 ‘신의 영역’이죠.

2024년: MS 플라이트 시뮬레이터 2024와 현실과 같은 하늘

올해 출시된 마이크로소프트 플라이트 시뮬레이터 2024는 단순한 게임이 아닙니다.

- 전 세계 모든 공항과 도시가 구현되고,

- 실시간 날씨 변화와 공기 흐름까지 계산하며,

- 비행기의 모든 기기와 엔진 작동을 현실처럼 재현합니다.

이 모든 걸 실시간으로 계산하려면 어마어마한 GPU 성능이 필요합니다. 최신 RTX 50 시리즈가 아니면 부드럽게 돌리기도 힘들 정도죠.

이처럼 게임의 발전과 함께 GPU의 연산 성능이 급격히 증가해왔으며, AI 모델 학습에서도 GPU의 고성능 연산 능력이 필수적입니다.

2) CPU vs GPU: 차이점과 역할

| 항목 | CPU(중앙처리장치) | GPU(그래픽처리장치) |

|---|---|---|

| 코어 개수 | 24개 내외 | 10,000개 이상 |

| 연산 속도 | 빠르지만 병렬 연산에 약함 | 대량 연산을 병렬로 처리 |

| 유연성 | 운영체제 실행, 다양한 프로그램 가능 | 단순 연산 전용 |

| 비유 | 점보 여객기(빠르지만 처리량 제한) | 대형 화물선(속도는 느리지만 대량 처리 가능) |

AI 학습과 같은 대량 연산 작업에서는 CPU보다 GPU가 더 적합하며, 특히 VRAM이 넉넉한 GPU가 필요합니다.

최근 엔비디아는 AI와 고사양 게임 분야에서의 수요를 충족하기 위해 GeForce RTX 50 시리즈를 출시했습니다. 이 시리즈는 새로운 Blackwell 아키텍처를 기반으로 하며, 이전 세대보다 향상된 성능과 효율성을 제공합니다. 그럼 GeForce RTX 50 에 대하여 간단히 알아볼까요?

4. GeForce RTX 50 시리즈의 특징

RTX 50 시리즈는 GDDR7 메모리를 탑재하여 데이터 전송 속도와 대역폭을 크게 향상시켰습니다. 예를 들어, RTX 5090은 32GB의 GDDR7 메모리를 장착하여 복잡한 AI 모델과 고해상도 게임을 원활하게 처리할 수 있습니다. 또한, 이 시리즈는 DLSS 4 기술을 통해 AI 기반 프레임 생성을 지원하여 그래픽 성능을 극대화합니다.

그러나 엔비디아의 GeForce RTX 50 시리즈 출시 이후, 국내 시장에서는 그래픽카드 가격이 급등하고 있습니다. 특히, RTX 5090과 RTX 5080 모델은 한정된 초기 물량으로 인해 품귀 현상을 빚으며, 출시 직후 완판되는 상황이 발생했습니다. 엔비디아는 RTX 5080의 레퍼런스(표준 모델) 출고 가격을 999달러(약 144만 원)로 책정했으나, 국내 유통 과정에서 가격이 크게 상승하여 220만 원에서 280만 원 이상에 판매되고 있습니다. 최상위 모델인 RTX 5090의 경우, 출시 첫날 360만 원대에 소량 판매되었으나, 중고 거래 사이트에서는 500만 원에서 600만 원대의 웃돈이 붙은 거래가 이루어지고 있습니다.

이러한 현상의 주요 원인 중 하나는 엔비디아가 인공지능(AI) 수요 증가에 대응하기 위해 산업용 GPU 생산에 집중하면서, 일반 소비자용 GPU 공급이 줄어든 데 있습니다. AI 기술의 발전과 함께 데이터 센터 및 연구 기관에서 고성능 GPU에 대한 수요가 폭발적으로 증가하였고, 엔비디아는 이러한 시장의 요구를 충족시키기 위해 자원을 재배치하고 있습니다.

엔비디아는 2016년 딥러닝 전용 GPU인 Tesla P100을 발표하며 AI 및 데이터 센터 시장으로의 진출을 본격화했습니다. 이후 AI 연구와 자율 주행 기술의 발전으로 GPU 수요가 급증하였고, 엔비디아는 AI와 데이터 센터 사업에서 큰 성장을 이루었습니다. 이러한 전략적 사업 확장은 엔비디아를 AI 시장의 선도 기업으로 자리매김하게 했으며, 현재 AI 반도체 산업의 밸류 체인을 주도하고 있습니다.

그러나 이러한 산업용 GPU 생산 집중은 일반 소비자용 GPU의 공급 부족으로 이어져, RTX 50 시리즈와 같은 최신 그래픽카드의 가격 상승과 품귀 현상을 초래하고 있습니다. 엔비디아는 이러한 문제를 해결하기 위해 다양한 노력을 기울이고 있으며, AI 시장과 소비자 시장의 균형을 맞추기 위한 전략을 지속적으로 모색하고 있습니다.

1) 향상된 VRAM 및 연산 성능

RTX 50 시리즈는 GDDR7 메모리를 탑재하여 데이터 전송 속도와 대역폭을 크게 향상시켰습니다. 예를 들어, RTX 5090은 32GB의 GDDR7 메모리를 장착하여 복잡한 AI 모델과 고해상도 게임을 원활하게 처리할 수 있습니다. 또한, 이 시리즈는 DLSS 4 기술을 통해 AI 기반 프레임 생성을 지원하여 그래픽 성능을 극대화합니다.

2) 다양한 모델 구성

RTX 50 시리즈는 다양한 사용자 요구를 충족하기 위해 여러 모델로 출시되었습니다. RTX 5070 Ti는 16GB의 GDDR7 메모리를 탑재하여 1440p 해상도에서 우수한 성능을 제공하며, RTX 5080은 16GB의 메모리로 4K 게이밍과 AI 연산에 최적화되어 있습니다. 최상위 모델인 RTX 5090은 32GB의 메모리와 뛰어난 연산 능력으로 최고 수준의 성능을 자랑합니다.

엔비디아의 최신 GeForce RTX 50 시리즈 그래픽카드가 국내 시장에 출시되면서, 공식 발표된 가격과 환율을 고려한 예상 가격 간의 차이가 논란이 되고 있습니다. 아래 표는 각 모델의 미국 출시 가격과 이를 환율(1달러 = 1,452원)로 환산한 예상 가격, 그리고 엔비디아 공식 홈페이지에 공개된 국내 출고가를 비교한 것입니다.

| 모델 | 미국 출시 가격(USD) | 환율 적용 예상 가격(KRW) | 국내 출고가(KRW) | 가격 차이율(%) |

|---|---|---|---|---|

| RTX 5090 | $1,999 | 약 2,900,000원 | 3,699,000원 | 약 27.4% |

| RTX 5080 | $999 | 약 1,450,000원 | 1,899,000원 | 약 30.8% |

| RTX 5070 Ti | $749 | 약 1,080,000원 | 1,399,000원 | 약 29.5% |

| RTX 5070 | $549 | 약 790,000원 | 1,009,000원 | 약 27.7% |

참고: 환율은 2025년 1월 7일 기준 1달러 = 1,452원으로 계산되었습니다.